Uwaga! Przed aktualizacją należy wykonać backup środowiska. Jeśli wykonana była próba aktualizacji bez otrzymanej instrukcji, należy w pierwszej kolejności usunąć PVC (Persistent Volume Claim) o nazwie ezdrp-logi-storage, znadujące się w Rancher > Storage > PersistentVolumeClaims i jeszcze raz przejść aktualizację według poniższych wytycznych.

Proces aktualizacji należy rozpocząć od zalogowania się do Ranchera za pomocą dowolnej przeglądarki. Zainstalowany Rancher dostępny będzie pod adresem: https://ip_serwera:8443. Po zaakceptowaniu certyfikatu wyświetli się strona strona powitalna Ranchera.

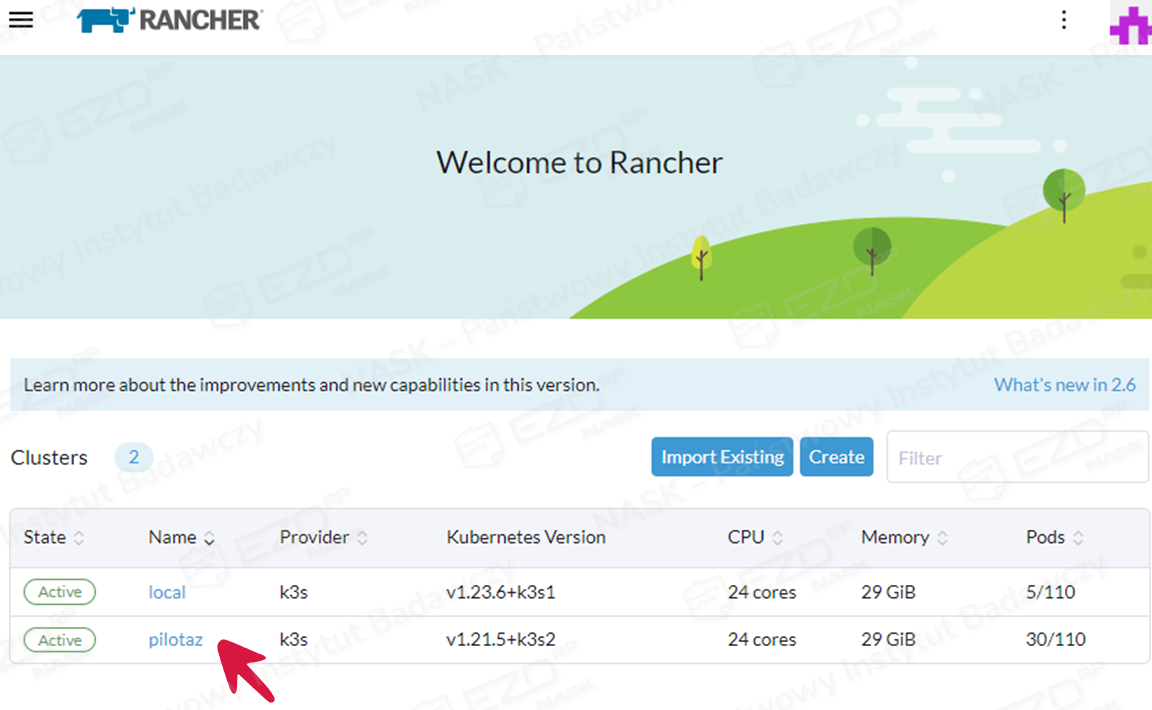

Domyślnym loginem użytkownika jest admin. W polu Password wpisujemy swoje, wcześniej ustalone hasło. Następny krok to wybranie odpowiedniego, utworzonego wcześniej klastra. W naszym przykładzie jest to klaster pilotaz.

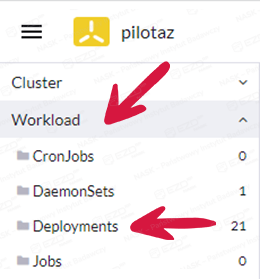

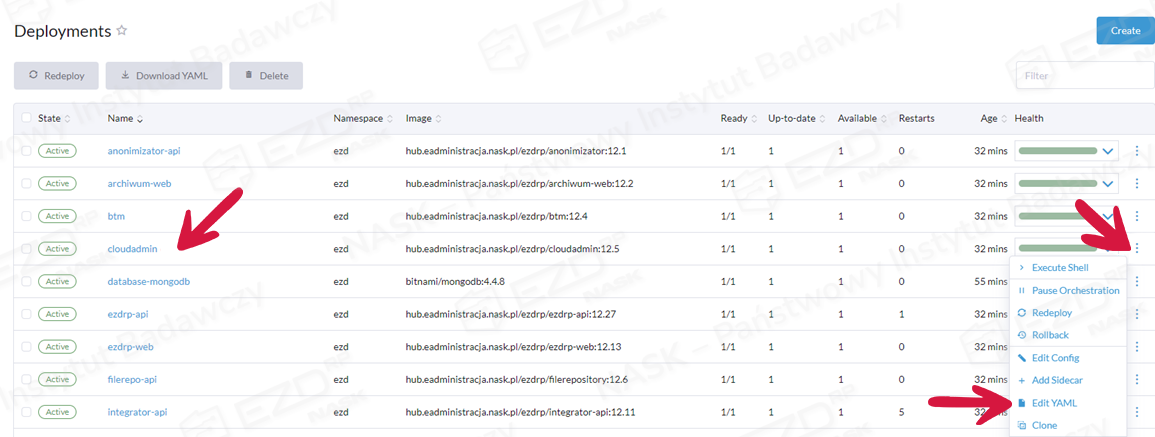

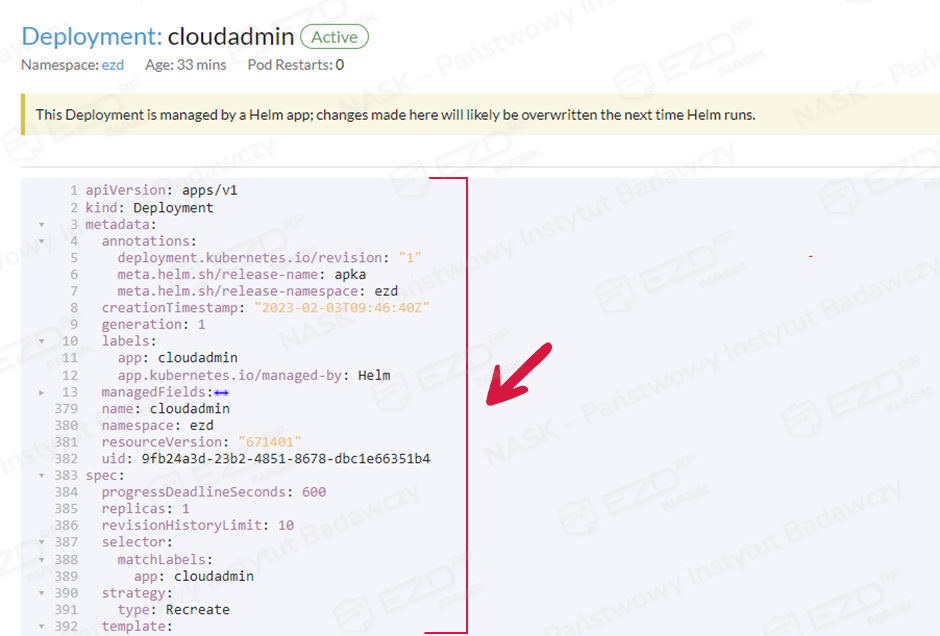

Po wykonaniu archiwizacji środowiska EZD RP (backupu), wykonujemy kopię Cloudadmin. W tym celu należy wybrać Workload > Deployments.

Następnie wybieramy Cloudadmin, klikamy ikonę menu podręcznego (trzy kropki) i opcję Edit YAML.

Należy skopiować całą zawartość YAML i zapisać ją w pliku tekstowym, np. przy użyciu edytora Notepad.

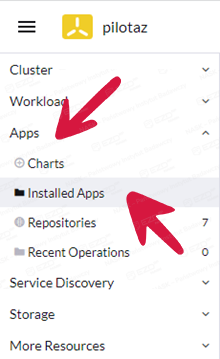

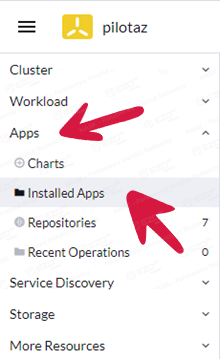

Następnie przechodzimy do aktualizacji aplikacji. W tym celu klikamy Apps > Installed Apps.

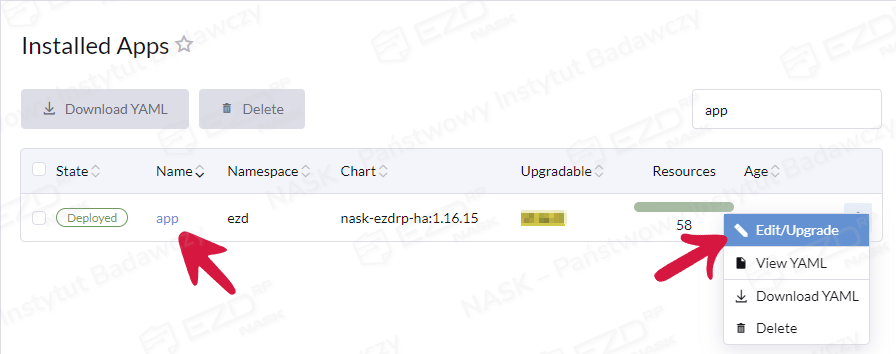

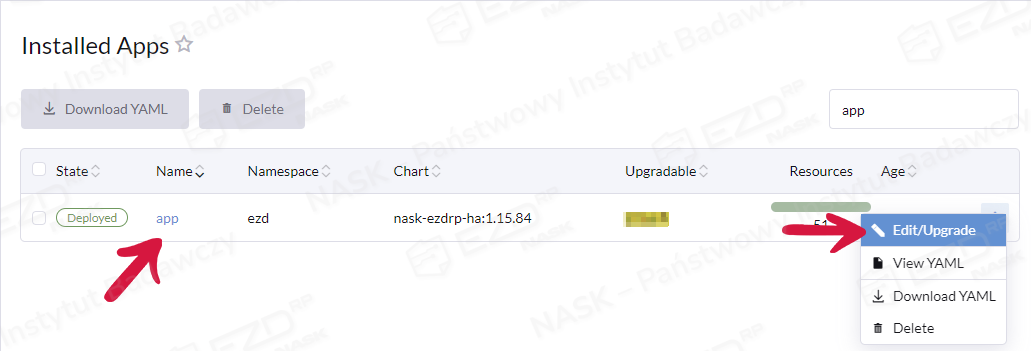

Zaznaczamy aplikację (w naszym przykładzie o nazwie app), klikamy ikonę menu podręcznego (trzy kropki) i wybieramy opcję Edit/Upgrade.

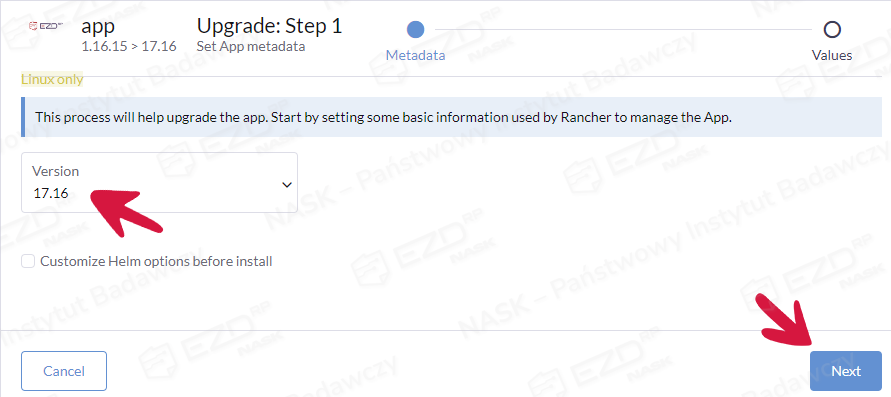

Odszukujemy wersję 1.17.16 i klikamy Next.

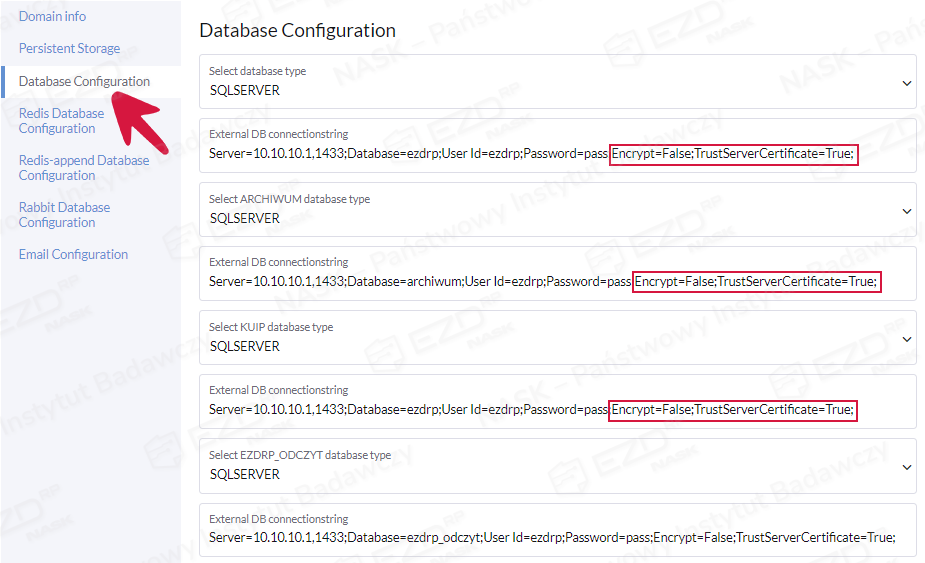

W kolejnym kroku weryfikujemy Database Configuration. Jeśli łączymy się z bazą Postgres, możemy pominąć tę czynność i przejść dalej. Natomiast jeśli łączymy się z bazą MS SQL, należy dodać na końcu w connection stringu frazę Encrypt=False;TrustServerCertificate=True;.

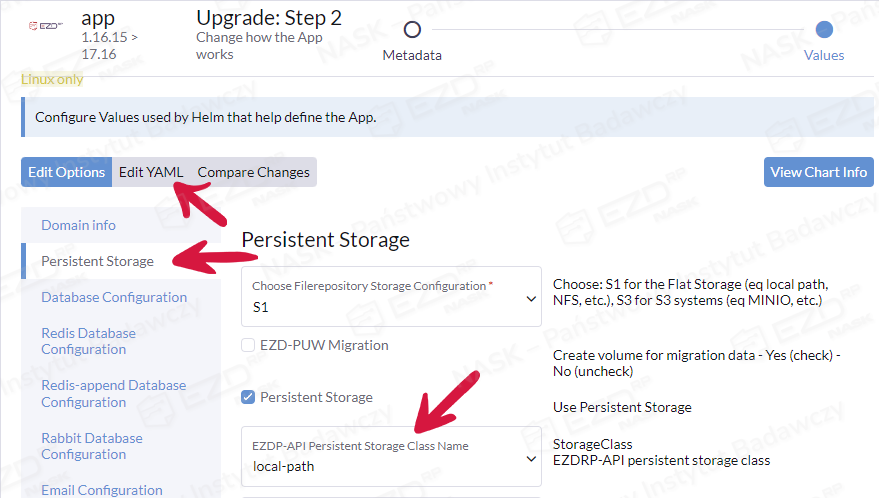

Następnie weryfikujemy, jak został ustawiony Persistent Storage Class. Jeśli wybrany jest local-path, należy wprowadzić zmiany opisane niżej. Jeśli natomiast ustawiona jest wartość nfs-client lub longhorn, możemy przejść od razu do kolejnego kroku – weryfikacji Database Configuration.

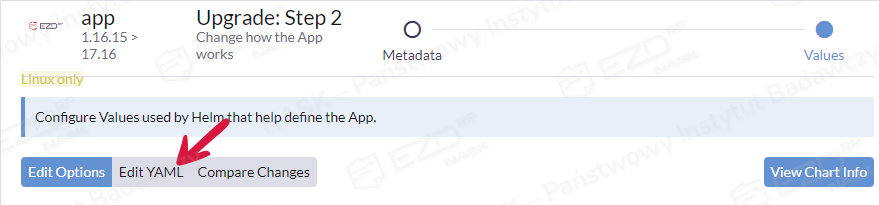

W wypadku ustawienia local-path należy kliknąć Edit YAML.

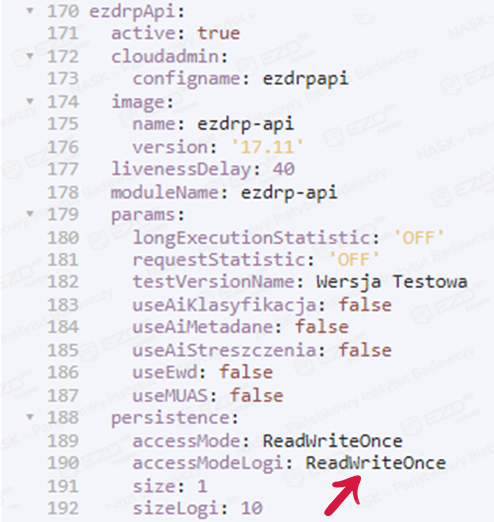

Następnie w schemacie ezdrpApi odszukujemy accessModeLogi: i zmieniamy wartość z ReadWriteMany na ReadWriteOnce.

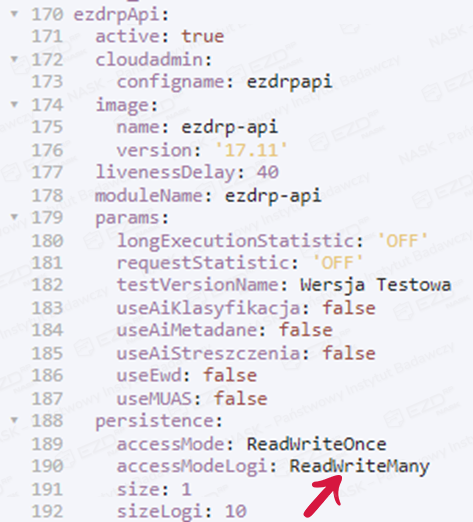

Widok przed zmianą:

Widok po zmianie:

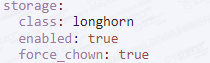

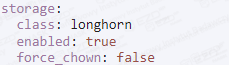

Odnajdujemy linijkę force_chown, zmieniając parametr na true.

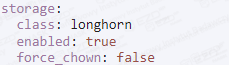

Widok przed zmianą:

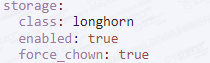

Widok po zmianie:

Jeśli wszystko jest prawidłowo ustawione, klikamy przycisk Upgrade.

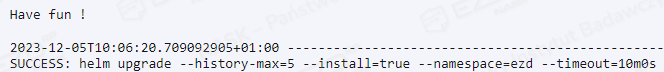

Po prawidłowej aktualizacji w logu pojawi się napis SUCCESS.

Ponownie przechodzimy do aktualizacji aplikacji, klikając Apps > Installed Apps.

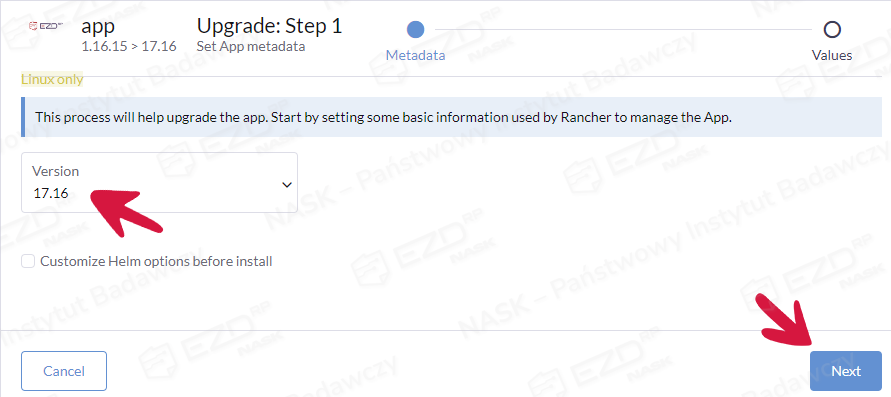

Zaznaczamy aplikację (w naszym przykładzie jest to app), klikamy ikonę menu podręcznego (trzy kropki) i wybieramy opcję Edit/Upgrade.

Odszukujemy wersję 17.16 i klikamy Next.

Po kliknięciu Next przechodzimy do zakładki Edit YAML i modyfikujemy linijkę force_chown, zmieniając parametr na false.

Widok przed zmianą:

Widok po zmianie:

Następnie klikamy przycisk Upgrade.

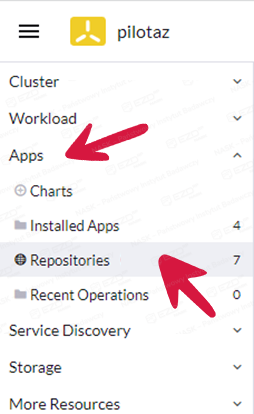

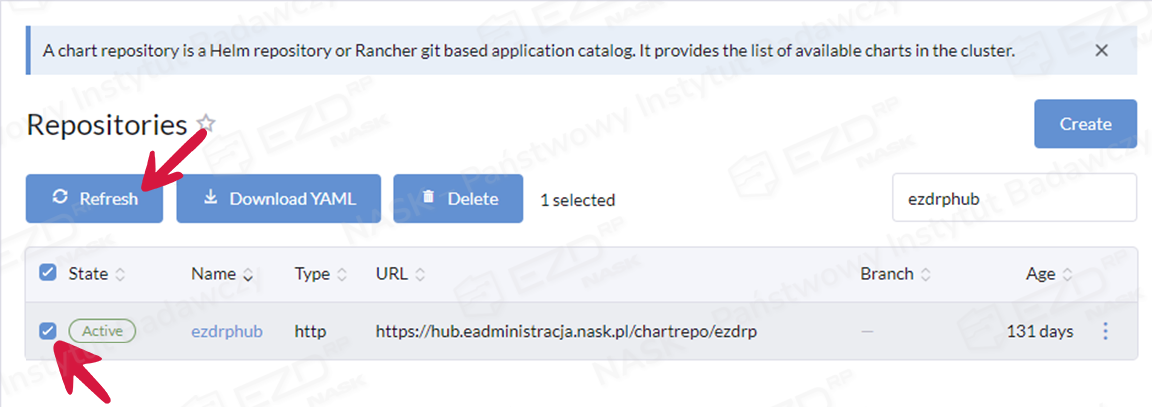

Uwaga! Jeśli nie pojawi się wersja 17.16, należy wrócić do zakładki Apps i kliknąć pozycję Repositories.

W widoku Repositories należy odświeżyć listę z repozytoriami.

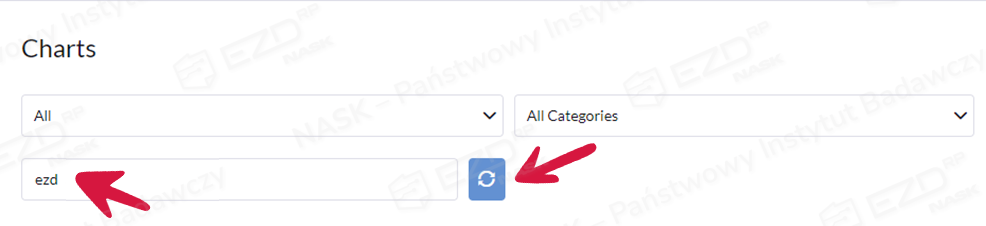

Dodatkowo możemy zdecydować się na odświeżenie w widoku Charts, wpisując w filtrze ezd i wybierając ikonę odświeżenia.

Po wykonaniu powyższych czynności wracamy do Apps > Installed Apps i sprawdzamy, czy pojawiła się nowa wersja 17.16.

Najczęstsze problemy

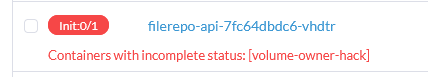

Pojawienie się komunikatu volume-owner-hack przy uruchamianiu się podu filerepo-api z statusem Init:0/1.

W przypadku posiadania dość sporej ilości dokumentów w storage, uruchomienie tego poda może potrwać.

Pojawienie się komunikatu volume-owner-hack przy uruchamianiu się podów ezdrp-api/sso-identityserver/filerepo-api/wpe-rest z statusem Init:crashloopback.

Aby rozwiązać ten problem, w pliku exports na serwerze NFS należy dodać parametr no_root_squash.

sudo nano /etc/exports

/nfs XXX.XXX.XXX.XXX(rw,sync,no_subtree_check,no_root_squash)Następnie należy zrestartować serwer NFS.

sudo systemctl restart nfs-serverW kolejnym kroku wykonujemy aktualizację. Jeśli pody uruchomią się prawidłowo, należy ponownie edytować plik exports i usunąć parametr no_root_squash.

sudo nano /etc/exports

/nfs XXX.XXX.XXX.XXX(rw,sync,no_subtree_check)Na koniec restartujemy serwer NFS.

sudo systemctl restart nfs-server